Тekst je deo serijala zasnovanog na istraživanju sprovedenom među 302 visokoobrazovana ispitanika u Srbiji o načinima korišćenja i stepenu poverenja u velike jezičke modele (Large Language Models – LLM) poput ChatGPT-a, Grok-a i Claude-a.

Cilj istraživanja odnosio se na ispitivanje učestalosti korišćenja velikih jezičkih modela u svakodnevnom životu i pri donošenju važnih odluka, iskustava korisnika sa netačnim odgovorima, navika provere informacija, kao i poređenje poverenja u AI sa poverenjem u stručnjake, porodicu i tradicionalne izvore informacija.

Dobijeni rezultati pružaju uvid u to kako visokoobrazovani korisnici u Srbiji koriste ove alate i koji činioci utiču na njihovo poverenje i oslanjanje na sisteme veštačke inteligencije.

Čovek vs. mašina: kome verujemo?

Uprkos sve većoj upotrebi alata veštačke inteligencije u poslovanju i privatnom životu, većina visokoobrazovanih građana u Srbiji i dalje ključne odluke radije donosi oslanjajući se na ljude nego na mašine, češće slede savet porodice i prijatelja i više veruju stručnjacima kada se njihovo mišljenje razlikuje od odgovora velikih jezičkih modela (Large Language Models – LLM).

Ipak, podaci pokazuju da značajan deo ispitanika već pravi drugačiji izbor: između četvrtine i petine njih u određenim situacijama daje prednost veštačkoj inteligenciji u odnosu na ljude, češće prati savet LLM-a nego savet bliskih osoba, ili veruje AI alatu više nego stručnjaku.

Baš zbog te rastuće manjine koja daje prednost mašini, otvara važno pitanje: da li se način na koji donosimo odluke neprimetno, ali suštinski menja?

Jesu li mašine naši novi najbolji prijatelji?

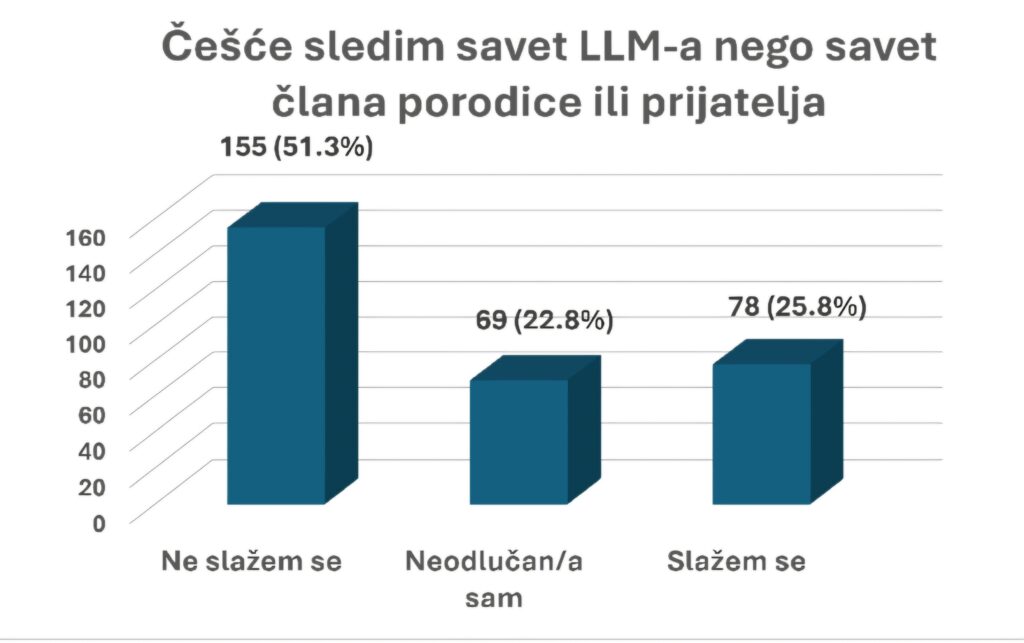

Većina ispitanika i dalje više veruje drugim ljudima nego mašini: više od polovine češće sledi savet porodice i prijatelja (51,3%). Ipak, činjenica da četvrtina ispitanika (25,8%) češće prati savet velikih jezičkih modela nego savet bliskih ljudi pokazuje da se obrazac oslanjanja na druge već menja.

Za neke ljude, je lakše pitati model nego pozvati člana porodice ili prijatelja, naročito kada su pitanja lična, osetljiva ili potencijalno „neprijatna“ ili “neprimerena”. Navedeno naročito važi za one koji imaju narušene porodične odnose ili introvertne osobe koje imaju manji broj prijatelja i manje socijalnih kontakata.

Osim toga, neretko posoji strah zbog mogućeg odbijanja ili osude. Kod osoba sa izraženijom socijalnom anksioznošću ili lošim iskustvima u komunikaciji, model postaje “prijatelj” koji ne vrši emocionalni pritisak.

Model ne reaguje emotivno, čime se smanjuje tenzija koja je često prisutna u direktnom razgovoru sa ljudima, ma kako nam bliski oni bili.

Novi autoriteti u digitalnom dobu

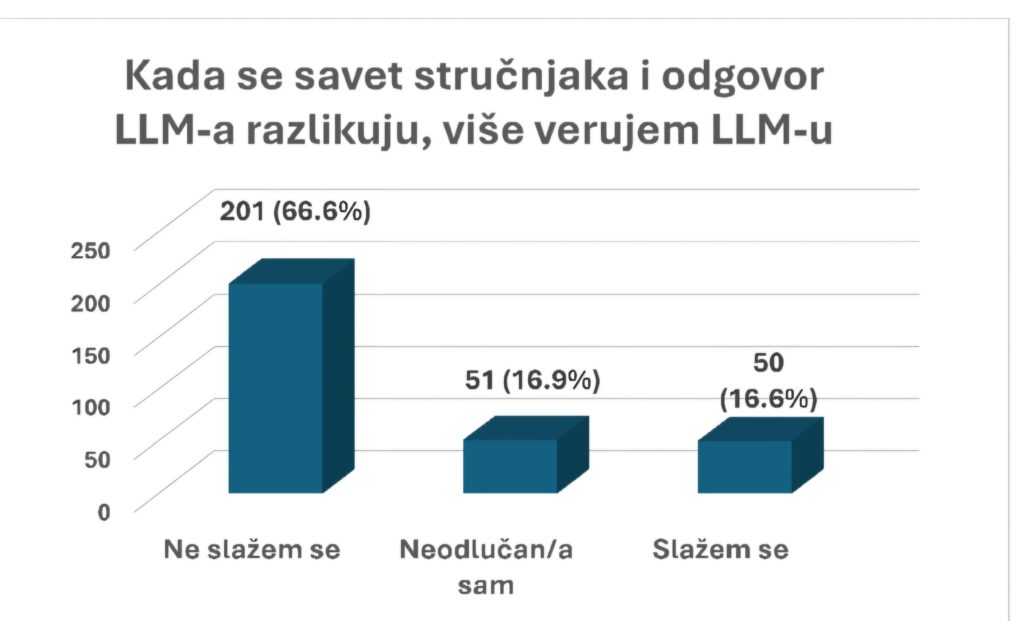

Kada se savet stručnjaka i odgovor LLM-a razlikuju, većina ispitanika i dalje daje prednost stručnjaku (66,6%). Ipak, gotovo svaki šesti ispitanik (16,6%) veruje modelu više nego stručnjaku. To znači da se kod gotovo trećine ispitanika javlja kolebanje ili spremnost da se autoritet eksperta dovede u pitanje.

Na prvi pogled, stručnjaci u svojoj oblasti su i dalje autoriteti i njihova reč ima veću težinu. Mišljenje eksperta se i dalje doživljava kao relevantno, jer iza njega stoje godine obrazovanja, licenca, profesionalna etika i lična odgovornost. Nasuprot tome, veliki jezički modeli su bez stvarnog razumevanja konteksta, empatije kao i bez odgovornosti.

Međutim, deo ispitanika AI modele doživljava potpuno drugačije. LLM često zvuči samouvereno i daje opširne, strukturirane odgovore koji podsećaju na enciklopedijski stil pisanja. Takav način izlaganja stvara utisak da model raspolaže širim znanjem nego stručnjaci specijalizovani za jednu oblast.

Odgovor se dobija gotovo odmah, bez čekanja i bez procedura koje obično prate razgovor sa stručnjakom. U stvarnosti, stručnjaci su često nedostupni ili prezauzeti, potrebno je zakazati termin, izdvojiti novac, a jedan razgovor neretko nije dovoljan da se problem reši do kraja.

Sa druge strane, LLM pruža odgovor za nekoliko sekundi i omogućava korisniku da bez ograničenja postavlja nova pitanja, traži pojašnjenja i produbljuje temu. Takva dinamika mnogima deluje jednostavnije i efikasnije od klasičnog odlaska kod stručnjaka, naročito kada su u fazi informisanja ili pokušavaju da razumeju problem pre nego što donesu odluku.

Paradoks neutralnosti

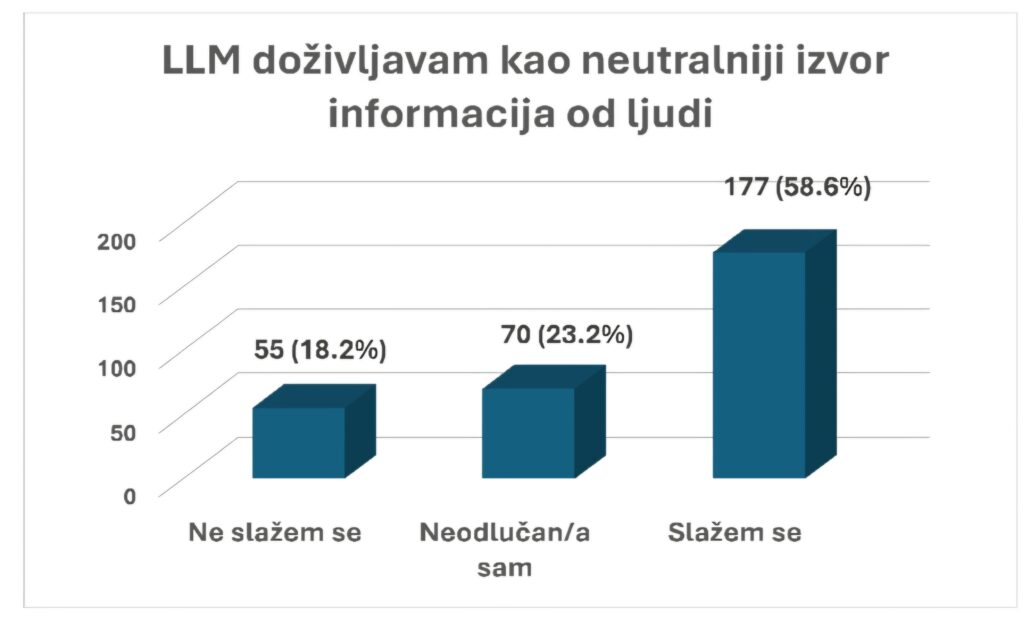

Iako većina i dalje više veruje ljudima, 58,6% ispitanika smatra da je LLM neutralniji izvor informacija od ljudi. Samo 18,2% se ne slaže sa tom tvrdnjom.

Model nema emocije i lične interese. Ne brine o tome kako će njegov odgovor biti shvaćen, ne pokušava da održi odnos sa sagovornikom i nema potrebu da nekoga ubedi ili razuveri. Odgovori su mu jasno strukturirani, napisani mirnim i ujednačenim tonom i deluju kao da su zasnovani isključivo na činjenicama, pa se takav način izlaganja često doživljava kao znak objektivnosti.

Sa druge strane, saveti porodice i prijatelja su obojeni brigom i željom da se pomogne ili čak utiče na odluku. Zbog toga takav savet ne zvuči kao neutralna informacija, već kao lični stav, kao nešto što dolazi od nekoga ko nas poznaje, ima svoje mišljenje i očekivanja i kao nešto što je formirano iz sopstvenog iskustva, koje može biti ograničeno.

Slično je i sa stručnjacima. Njihov savet se ne doživljava kao „neutralan“, već kao procena konkretne osobe, sa sopstvenim iskustvom, stavovima i profesionalnim interesima. Ljudi su svesni da lekar, advokat ili finansijski savetnik može imati sopstveni ugao gledanja, institucionalna ograničenja, pa i ekonomski interes. Ponekad postoji i sumnja u skrivene motive, želju za zaradom, očuvanjem reputacije, postojanje profesionalnog ega ili potrebom da se održi autoritet.

Zašto je teško poveravati se ljudima?

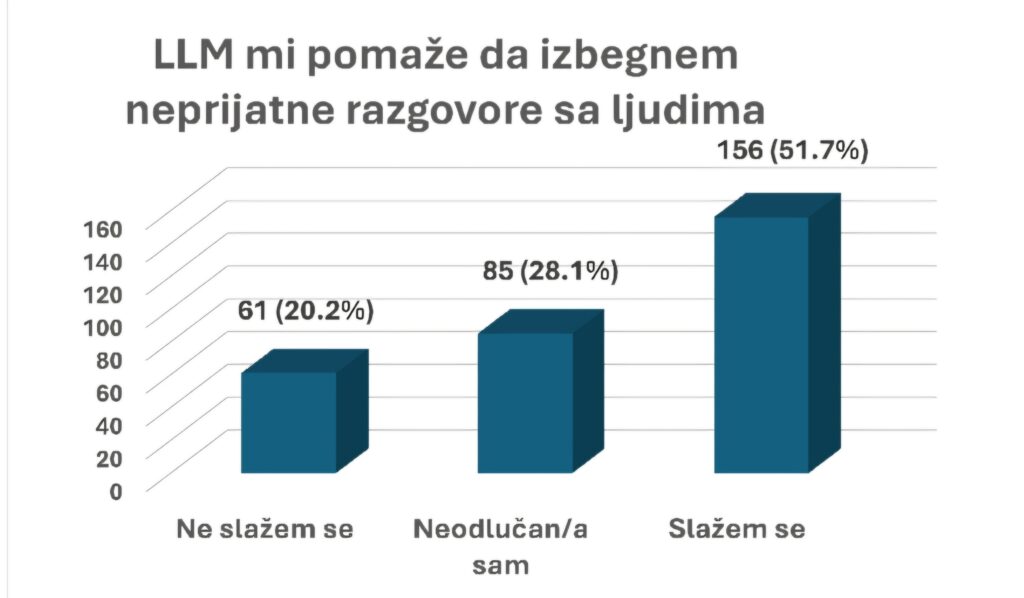

Više od polovine ispitanika (51,6%) navodi da im LLM pomaže da izbegnu neprijatne razgovore sa drugim ljudima, dok se jedna petina (20,2%) sa tim ne slaže.

LLM omogućava potpunu kontrolu nad komunikacijom. Korisnik bira kada počinje razgovor, o čemu govori i kada ga završava. Nema prekidanja, emotivnih reakcija, kritike ni obaveze da se odnos održava.

Važnu ulogu ima i osećaj privatnosti. Osetljive teme kao što su mentalno zdravlje, finansijski problemi, porodični odnosi, lakše je otvoriti u razgovoru sa AI sistemom nego sa drugom osobom, jer se veruje da će razgovor biti anoniman i da LLM neće “odati tajnu”.

U širem društvenom kontekstu, rezultati ovog istraživanja se poklapaju sa onim što već znamo. Internet, SMS poruke, aplikacije i društvene mreže su promenile način na koji ljudi komuniciraju. Dolaskom veštačke inteligencije komunikacija će postati sve više asinhrona i kontrolisana I bez socijalne dinamike koja ju je ranije pratila.

LLM omogućava potpunu kontrolu nad komunikacijom. Korisnik bira kada počinje razgovor, o čemu govori i kada ga završava. Nema prekidanja, emotivnih reakcija, kritike ni obaveze da se odnos održava.

Važnu ulogu ima i osećaj privatnosti. Osetljive teme kao što su mentalno zdravlje, finansijski problemi, porodični odnosi, lakše je otvoriti u razgovoru sa AI sistemom nego sa drugom osobom, jer se veruje da će razgovor biti anoniman i da LLM neće “odati tajnu”.

U širem društvenom kontekstu, rezultati ovog istraživanja se poklapaju sa onim što već znamo. Internet, SMS poruke, aplikacije i društvene mreže su promenile način na koji ljudi komuniciraju. Dolaskom veštačke inteligencije komunikacija će postati sve više asinhrona i kontrolisana I bez socijalne dinamike koja ju je ranije pratila.

Autor: Milena Šović, AI Implementation Specialist & AI Content Trainer

Foto: Pixabay